Chez Liberogic, nous travaillons à rendre la structure de notre site web plus lisible pour les agents d'IA et les LLM.

Il est devenu courant que non seulement les moteurs de recherche, mais aussi les LLM et les agents d'IA comme Claude, Gemini et ChatGPT, lisent des sites web, organisent et comparent les informations et effectuent des recherches pour le compte des utilisateurs.

Sur le site web de Liberogic, nous préparons également le terrain pour que l'IA puisse lire notre contenu en créant un fichier robots.txt, un plan du site, des en-têtes de liens, un fichier llms.txt et en générant des fichiers Markdown pour chaque article.

Cette fois-ci, Cloudflare a publié quelque chose il y a deux semaines.「Is Your Site Agent-Ready?」Je vais écrire un article à ce sujet.

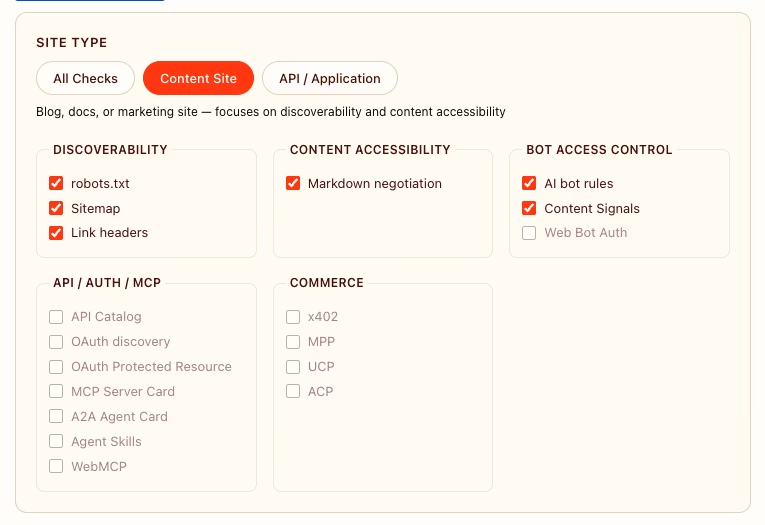

Site de contenu vérifié

Le site web de Liberogic est un site institutionnel proposant des informations sur l'entreprise, des présentations de services, des actualités, des chroniques, des études de cas, etc. Il ne s'agit ni d'un site de commerce électronique, ni d'une application API nécessitant une authentification OAuth.

Le type de site lors de la vérification du serveur est「Content Site」Choisissez-en un.

Les éléments liés au commerce, aux API/à l'authentification/au MCP seront exclus de cette évaluation, et nous nous concentrerons principalement sur les aspects suivants.

- Discoverability

- Content Accessibility

- Bot Access Control

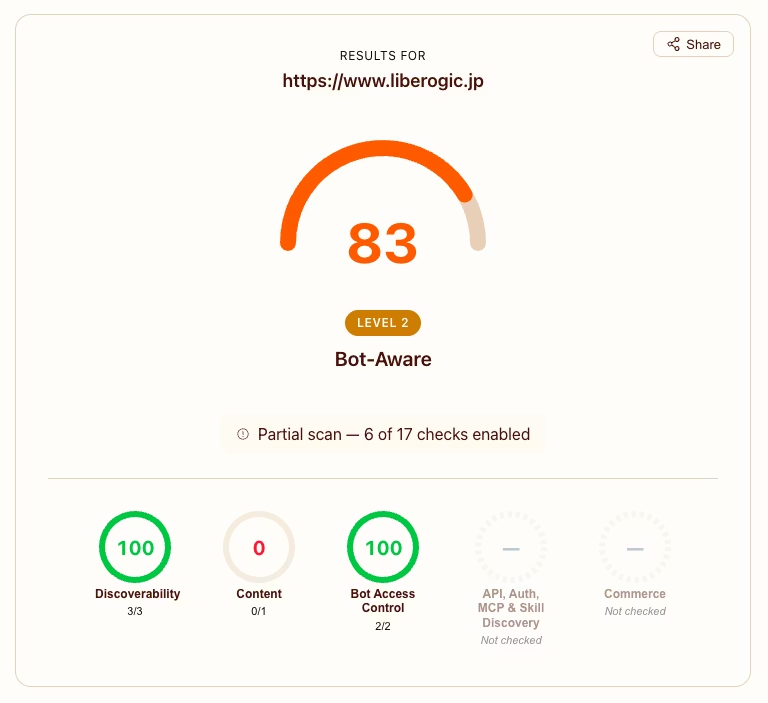

En conséquence... le score est83点、Niveau 2「Bot-Aware」Voilà ce qui s'est passé 😭

Pourquoi n'a-t-on pas obtenu la note maximale ?!

Vérifions/confirmons cela immédiatement.

Lors de ce contrôle, Discovery et Bot Access Control ont tous deux obtenu un score de 100 points.

Nous avons mis en œuvre la prise en charge d'éléments tels que robots.txt, sitemap, en-têtes de liens, règles des robots d'IA et signaux de contenu, et nous avons établi les voies de base permettant au robot d'IA de découvrir le site et de comprendre les politiques d'accès.

En termes simples,

- Amener les gens à découvrir le site

- Indiquez-nous où se trouve le contenu.

- Ce document décrit la politique d'accès pour les robots.

- Signaux pour l'IA

Ce sont les points qui ont déjà été abordés.

En revanche, j'ai obtenu la note de 0 pour l'accessibilité du contenu (TT).

À première vue, on pourrait penser : « Attendez, je ne peux pas lire le contenu ? », mais la réalité est un peu différente.

Le contenu Markdown est déjà préparé.

Sur le site web de Liberogic, un certain pourcentage du contenu des articles et des études de cas est déjà généré au format Markdown, ce qui facilite la lecture par l'IA.

Les articles et les études de cas comportent des fichiers Markdown, et l'en-tête de chaque page contient une balise de lien vers le contenu Markdown, offrant ainsi à l'agent d'IA un chemin clair pour accéder aux fichiers Markdown.

Ce n'est pas qu'il ne prenne pas en charge Markdown ; LLM est plutôt conçu pour récupérer le texte dans un format lisible, il ne s'agit donc pas d'un problème de « non-prêt à être lu par l'IA ».

Alors pourquoi je n'ai pas eu la note maximale ? 👺

La raison pour laquelle le site n'a pas obtenu la note maximale cette fois-ci n'est pas due à un manque d'efforts de sa part, mais à l'incompatibilité entre la configuration actuelle de l'implémentation et les spécifications d'évaluation de l'outil de vérification.

Le site web de Liberogic est implémenté à l'aide de SSG d'Astro, et la page de prévisualisation est une conception hybride utilisant SSR.

Alors que la négociation Markdown est généralement gérée par un middleware, la configuration hybride utilise un adaptateur Cloudflare, et son fichier de sortie, _worker.js, est prioritaire. Par conséquent, le middleware ne se charge pas et la négociation Markdown n'est pas prise en compte par l'outil de vérification.

En réalité, il existe un fichier Markdown, et il est accessible via une balise de lien dans la section head, mais l'outil de vérification le détectait comme « Négociation Markdown non détectée ! »

Mince alors ! Ils ont fait un truc à moitié cuit !

…Bien que je sois tenté de le dire, je compte bien sûr sur Cloudflare au quotidien.

Merci d'avoir approuvé notre certification de partenaire.

Mais pour quelqu'un qui visait la note parfaite à Lighthouse, c'est un peu décevant.

Il est possible d'obtenir un score parfait ! Mais je ne veux pas sacrifier l'efficacité opérationnelle ni engendrer de coûts supplémentaires simplement pour obtenir un score élevé.

Il existe plusieurs solutions possibles.

- Une instance distincte de Cloudflare Workers est configurée pour renvoyer du Markdown.

- Convertissez la page d'aperçu en CSR et rapprochez-la d'une configuration SSG complète.

- Passez à un forfait Business pour Cloudflare et réécrivez les URL à l'aide des règles de transformation.

Voici quelques-unes des méthodes.

En effet, une amélioration d'un niveau du service de Cloudflare permettrait de rapprocher le score de l'outil de vérification de 100.

Cependant, à ce stade, décider de payer un supplément juste pour cela semble un peu discutable !

Notre objectif n'est pas d'obtenir un score parfait à un outil de vérification, mais plutôt de garantir que les agents d'IA et les LLM puissent interpréter correctement les informations du site web Liberogic. Du point de vue des LLM qui lisent le contenu, nous estimons avoir réalisé des progrès considérables dans la mise en œuvre des étapes nécessaires.

Plutôt que d'augmenter les coûts simplement pour obtenir une note parfaite, concentrez-vous sur la capacité à lire correctement.

Il doit pouvoir être utilisé correctement.

En tant qu'entreprise Liberology, nous souhaitons privilégier cet équilibre.

N'oubliez pas llms.txt !

Bien que cela ne figure pas dans cette liste de contrôle, chez Liberology/llms.txtCela le confirme également.

llms.txt est un fichier qui fait office de table des matières pour LLM, l'informant « quelles informations se trouvent sur ce site et quelles pages lire ».

Ce concept est similaire au fichier sitemap.xml des moteurs de recherche, mais il est plus adapté aux LLM, servant à organiser la vue d'ensemble du site et à fournir des chemins d'accès au contenu important.

Bien que cela ne soit pas inclus dans les éléments d'inspection de l'outil de vérification, Cloudflare privilégie la qualité des données, et plus précisément « la façon dont le contenu (texte principal) peut être capturé avec un minimum de bruit (c'est-à-dire s'il est au format Markdown) », ils l'ont donc peut-être intentionnellement omis.

Devrais-je simplement le laisser lire directement le code HTML ?

Lorsqu'un agent d'IA analyse un site web, il peut bien sûr analyser directement le code HTML.

Cependant, les pages web contiennent de nombreuses informations autres que le contenu principal, telles que la navigation, les en-têtes, les pieds de page, les éléments décoratifs et les contrôles JavaScript. Même les pages d'apparence naturelle contiennent souvent beaucoup de données parasites pour l'analyse LLM (Low-Level Matrix).

La conversion forcée de code HTML complexe en Markdown peut perturber la structure des titres, les listes et le sens voulu, ce qui peut donner des données difficiles à lire même pour des personnes titulaires d'un LLM.

Cela dit, je suis certain que ces problèmes seront bientôt résolus grâce aux progrès de l'IA, mais je pense qu'il est important d'agir dès maintenant, étape par étape. Où en sont vos sites web en matière d'intégration de l'IA ?

Malgré son rôle de PDG, il reste toujours à l'écoute. Il prend plaisir à comprendre les nouvelles technologies et à constater les améliorations apportées au confort d'utilisation. C'est une personne très impliquée, qui aime se plonger dans le monde réel. Il est enthousiaste quant aux technologies futures et souhaite continuer à vivre de nouvelles expériences, quel que soit son âge.

Morimoto

Chef de projet / Directeur / Fondée en 2007