リベロジックでは、自社サイトをAIエージェントやLLMにも読みやすい構造にするため対応を進めています。

検索エンジンだけでなく、Claude/Gemini/ChatGPTのようなLLMやAIエージェントがWebサイトを読み取り、情報を整理したり比較したりとユーザーの代わりに調査したりする場面が当たり前になってまいりました。

リベロジックのサイトでも、robots.txt、sitemap、Link headers、llms.txt、記事ごとのMarkdownファイル生成など、AIに読まれるための準備しています。

今回はCloudflareが先々週に公開した「Is Your Site Agent-Ready?」の件を記事にします。

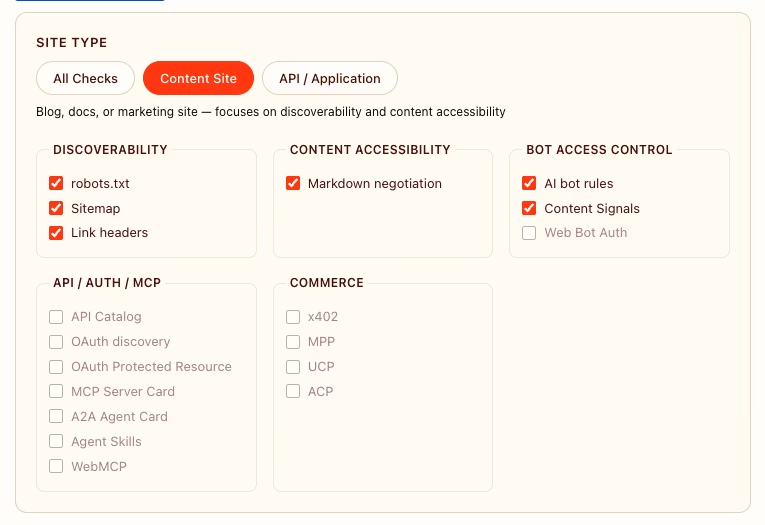

Content Siteとしてチェック

リベロジックのサイトは、会社情報、サービス紹介、ニュース、コラム、ケーススタディなどを掲載するコーポレートサイト・コンテンツサイトです。 ECサイトではありませんし、OAuth認証を伴うAPIアプリケーションでもありません。

よってチェック時のサイト種別は 「Content Site」 を選択します。

CommerceやAPI / Auth / MCP関連の項目は今回の評価対象外とし主に以下の観点で確認します。

- Discoverability

- Content Accessibility

- Bot Access Control

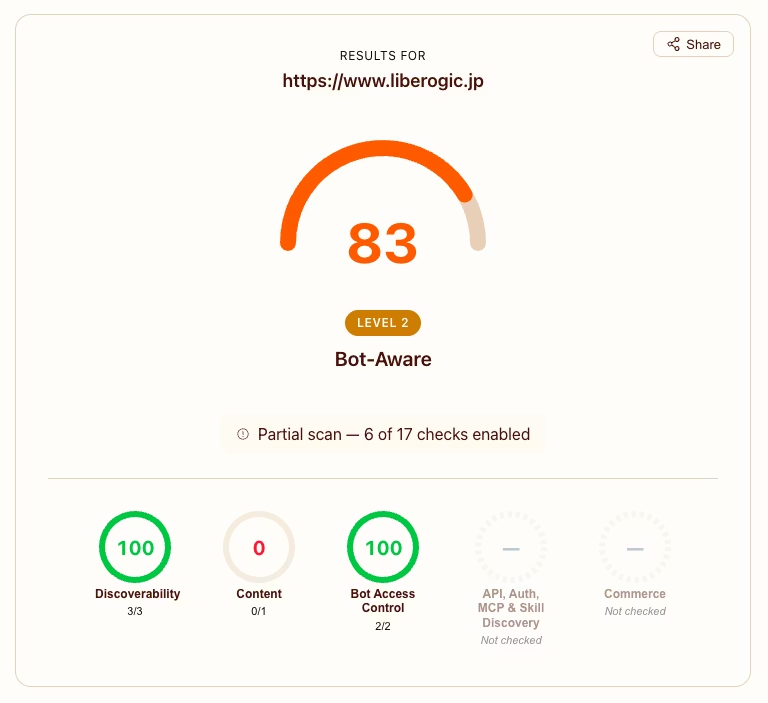

その結果……..スコアは 83点、Level 2「Bot-Aware」 となりました😭

なぜ100点ではないのか!!

さっそく検証 / 確認

今回のチェックではDiscoverabilityは100点とBot Access Controlも100点でした。

robots.txt、sitemap、Link headers、AI bot rules、Content Signalsといった項目は対応できており、AI botがサイトを発見しアクセス方針を理解するための基本的な導線は整備できています。

ざっくり言えば、

- サイトの存在を見つけてもらう

- どこにコンテンツがあるか伝える

- botに対するアクセス方針を示す

- AI向けのシグナルを出す

といった部分が対応済みというところです。

一方で、Content Accessibilityの項目は0点となりました(TT)

ここだけ見ると「え、コンテンツ読めないの?」となりそうですが実際は少し違います。

Markdownコンテンツ自体は既に用意済みです

リベロジックのサイトでは、記事コンテンツやケーススタディについてAIが読み取りやすいMarkdown形式のファイルを既に一定の割合にて生成しています。

記事もケーススタディもちゃんとMarkdownファイルがあり、各ページのhead内にはMarkdown版コンテンツへのlinkタグも設定しており、実際のAIエージェントがMarkdownファイルへたどり着ける導線も用意しています。

Markdownに未対応というわけではなく、LLMが読みやすい形で本文を取得できるようにしているため「AIに読ませる準備ができていない」という状態ではありません。

ではなぜ100点にならないのか👺

今回100点にならない理由はサイト側が何もしていないからではなく、現在の実装構成とチェックツール側の判定仕様の相性によるものです。

リベロジックのサイトはAstroのSSGで実装されており、プレビューページでSSRを利用したハイブリッドになっています。

Markdown negotiationについてはミドルウェアで処理するのが一般的なのですが、ハイブリッド構成のためにCloudflare アダプタを利用しており、その出力である_worker.jsが優先されます。そのためミドルウェアが読み込まれない状態になり、チェックツール側ではMarkdown negotiationが反映されない状態になってしまっているのです。

実際にはMarkdownファイルもありhead内のlinkタグからも到達できるのですが、チェックツールの見方では「Markdown negotiationが確認できないぞ!」と判定されてしまう状況でございました。

くそぉ!中途半端なもの作りやがって!

……と言いたくなる気持ちはありますが、もちろんCloudflareには日々お世話になっています。

パートナー認定のご承認もありがとうございます。

でもlighthouseで100点を追い続けていた身としてここはちょっと悔しいところです。

100点にすることは可能!でも点数のためだけに運用効率を落としたくないし費用はかけたくない

対応方法としては、いくつか考えられます。

- 別途Cloudflare Workersを立ててMarkdown返却を処理する

- プレビューページをCSR化し完全なSSG構成に寄せる

- Cloudflareのサービスプランをビジネスプランにし、Transform RulesでURLを書き換える

といった方法です。

そうなんです、Cloudflareのサービスを一段階上げればチェックツール上の判定を100点に近づけることは可能ではあります。

ただ現時点にてそのためだけに追加費用を払う判断はちょっと微妙ですよね!

目的はあくまでチェックツールで満点を取ることではなくAIエージェントやLLMがリベロジックのサイトにある情報を適切に読み取れる状態にすることなので、LLMがコンテンツを読むという観点で弊社は比較的、必要な対応はかなり進んでいると考えています。

100点を取るためだけにコストを増やすよりちゃんと読めること。

ちゃんと運用できること。

リベロジックとしてはそのバランスを大事にしたいところです。

llms.txtも忘れずに!

今回のチェック項目には含まれていませんが、リベロジックでは /llms.txt にも対応しています。

llms.txtはLLMに対して「このサイトにはどんな情報があり、どのページを読めばよいか」を伝えるための目次のようなファイルです。

検索エンジン向けのsitemap.xmlに近い考え方ですが、よりLLM向けにサイトの概要や重要なコンテンツへの導線を整理する役割を持ちます。

チェックツールの検査項目には含まれていないのですが、Cloudflareとしては「中身(本文)をいかに低ノイズで取得できるか(Markdown化されているか)」というデータ品質を重視しているため、あえて含めていないのかもしれません。

HTMLをそのまま読ませればいい?

AIエージェントにWebサイトを読ませる場合、当然HTMLをそのまま解析させることもできます。

ただ実際のWebページには、ナビゲーション / ヘッダー / フッター / 装飾用の要素 / JavaScriptによる制御など、本文以外の情報が多く含まれており、自然に見えるページでもLLMにとってはノイズが多くなってしまう場合が多いのです。

複雑なHTMLを無理にMarkdownへ変換すると、見出し構造やリスト、表現意図が崩れてしまうことがあり、結果としてLLMにとっても読みづらいデータになってしまう可能性があります。

なんて言っている間にこのあたりもすぐにAIの進化とともに改善されるのでしょうけど、今必要なことを一つ一つやっていくことが重要だと考えています。皆さんのサイトはどこまで対応が進んでますか??

社長でありながら常にカウンターパート。新しい技術を理解したり、何かが便利になる瞬間に喜びを感じ、ひたすら没頭する現場大好き人間。未来の技術にもわくわくしながら、いくつになっても新しい体験を楽しんでいたい。

森本さん

プロジェクトマネージャー / ディレクター / 2007年創業